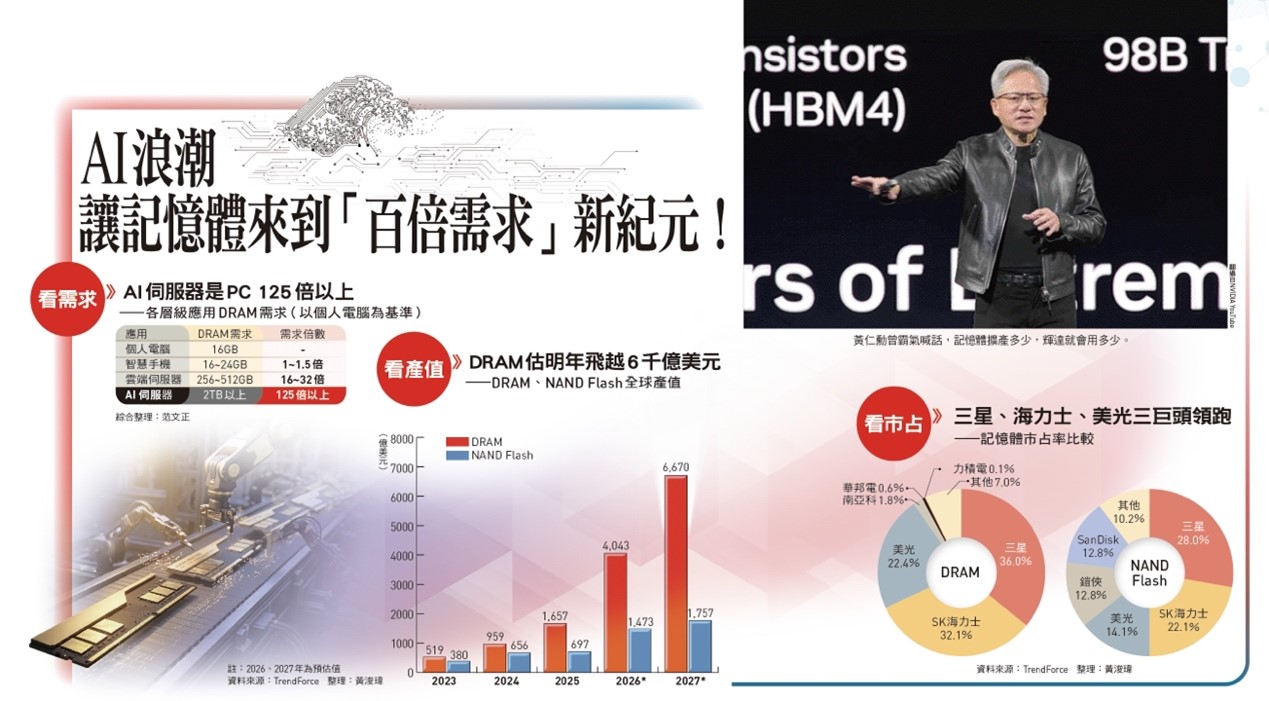

AI時代,一切似乎真的不同。為了打造AI競爭力,美國CSP(雲端服務商)持續擴大支出,產業市調機構TrendForce預估,美、中兩國八大CSP,今年總計斥資逾七千億美元(約二十二兆新台幣)進行基礎建設,另有從模型進展到推論的龐大地端硬體,以及資料儲存的需求。

全球科技產業突然驚覺,為了擴張算力,須有更多GPU、更多儲存空間,來傳輸、儲存巨量資料,此時扮演儲存要角的記憶體,頓時成了歷史上從未有過的重要戰略物資。

回顧過去二十年,記憶體產業其實早已進行一場巨變。根據WSTS(世界半導體貿易統計組織)與Gartner等統計,○五年全球記憶體產值僅約四八○億美元,當時仍是PC主導的時代;而在剛落幕的二五年,記憶體產值在AI狂潮推動下,已衝破二千一百億美元大關,二十年成長三.三倍。

單看DRAM市場,○五年全球市場規模約二五○億美元;到二五年,已擴張至一千六百億美元以上。二十年間,成長超過五倍。

而NAND Flash的成長曲線則更加陡峭,○五年的市場仍小於百億美元,二五年已接近七百億美元。主要原因是SSD(固態硬碟)正全面取代傳統硬碟,從個人電腦到資料中心,SSD已成為主流儲存設備。

不同記憶體產品產值都拉出高角度的成長曲線,市場需求的強烈程度,讓全球三大廠不約而同展開擴廠競賽。二六年,三星計畫投資約兩百億美元,主要集中於DRAM與HBM的產能擴張及先進製程;SK海力士約投資二○五億美元,重點在HBM4與高階DRAM 產能;美光也將投資約兩百億美元,涵蓋DRAM、HBM及NAND的技術升級與產能維護。

記憶體晶片是所有電子設備的「大腦緩衝區」與「資料倉庫」。其中,DRAM是系統運算時的主記憶體,負責即時資料處理,但電源關閉後資料即消失;而NAND Flash則是儲存裝置的核心,負責長期儲存,從SSD到手機儲存皆不可或缺。兩者共同支撐了主要數位經濟的資料流動。

然而,在AI算力瘋狂成長的今日,DRAM也形成一場新的階級革命。當前最炙手可熱的莫過於HBM(高頻寬記憶體),它透過3D堆疊技術,大幅改善處理器與記憶體之間的傳輸瓶頸,為AI運算時不可或缺的極速通道,就像搭乘直升機直奔一○一大樓頂樓;也是記憶體三大廠競相宣布加速擴廠投資的關鍵產品。

巨頭拚高價HBM 排擠DRAM產能

傳統標準型DDR,廣泛應用於個人電腦與傳統資料中心伺服器,在擴充性與成本之間取得最佳平衡,支撐起絕大部分的日常運算需求。

此外,LPDDR(低功耗記憶體)不再局限於手機與輕薄筆電等應用。由於AI伺服器的功耗龐大,電力成本與散熱負擔驚人,輝達自Grace CPU開始,大膽捨棄伺服器常用的標準記憶體,改為大量導入LPDDR5X,追求高頻寬、低能耗的效能。

除了上述主力,SRAM(靜態隨機存取記憶體)容量小、成本極高,擁有最快的反應速度,通常直接整合在處理器內部,作為最貼近大腦的高速暫存區;而NOR Flash存放設備開機與系統運作的最核心程式碼,具有讀取速度快、資料極其穩定的特質。

簡而言之,AI運算不只是腦力競爭,更是一場資料搬運的競速賽局。用一○一樓頂作為運算總部來比喻,想快速到達頂樓,HBM是空中直升機,LPDDR是節能快速電梯,NAND是低樓層的大型倉庫。當數據在這些階級間流動,速度與節能,將決定誰是算力戰場的終極贏家。

_20260325101730.jpg_280x210.jpg)

_20260306145612.jpg_280x210.jpg)

_20260102153424_20260325230950.jpg_1140x855_280x210.jpg)